Πόσο κοντά είναι η εποχή των ρομπότ-πολεμιστών;

Πόσο κοντά είναι η εποχή των ρομπότ-πολεμιστών;

Δεκάδες πύραυλοι έπληξαν με απόλυτη ακρίβεια τους στόχους τους δίχως να χρειαστεί η επέμβαση χερσαίων δυνάμεων στα εχθρικά εδάφη. Θύματα δεν υπήρξαν, ούτε μεταξύ των επιτιθεμένων ούτε μεταξύ των πληγέντων. Η πυραυλική επιδρομή που εξαπέλυσαν τα ξημερώματα του Σαββάτου οι ΗΠΑ, με τη συνδρομή της Βρετανίας και της Γαλλίας, με στόχο να «τιμωρήσουν» το καθεστώς του Μπασάρ αλ Ασαντ για την πολλοστή επίθεση με χημικά όπλα (σύμφωνα με τη Δύση) κατά αμάχων στην πόλη Ντούμα, ήταν περισσότερο μια αυστηρή προειδοποίηση παρά μια «πράξη πολέμου». Αλλά αποτέλεσε, σίγουρα, και μια στρατιωτική επιχείρηση που προσεγγίζει ακόμα περισσότερο το σενάριο ενός «ρομποτικού πολέμου» – σενάριο το οποίο έχουν ήδη ξεκινήσει να γράφουν οι μεγάλες στρατιωτικές δυνάμεις του πλανήτη.

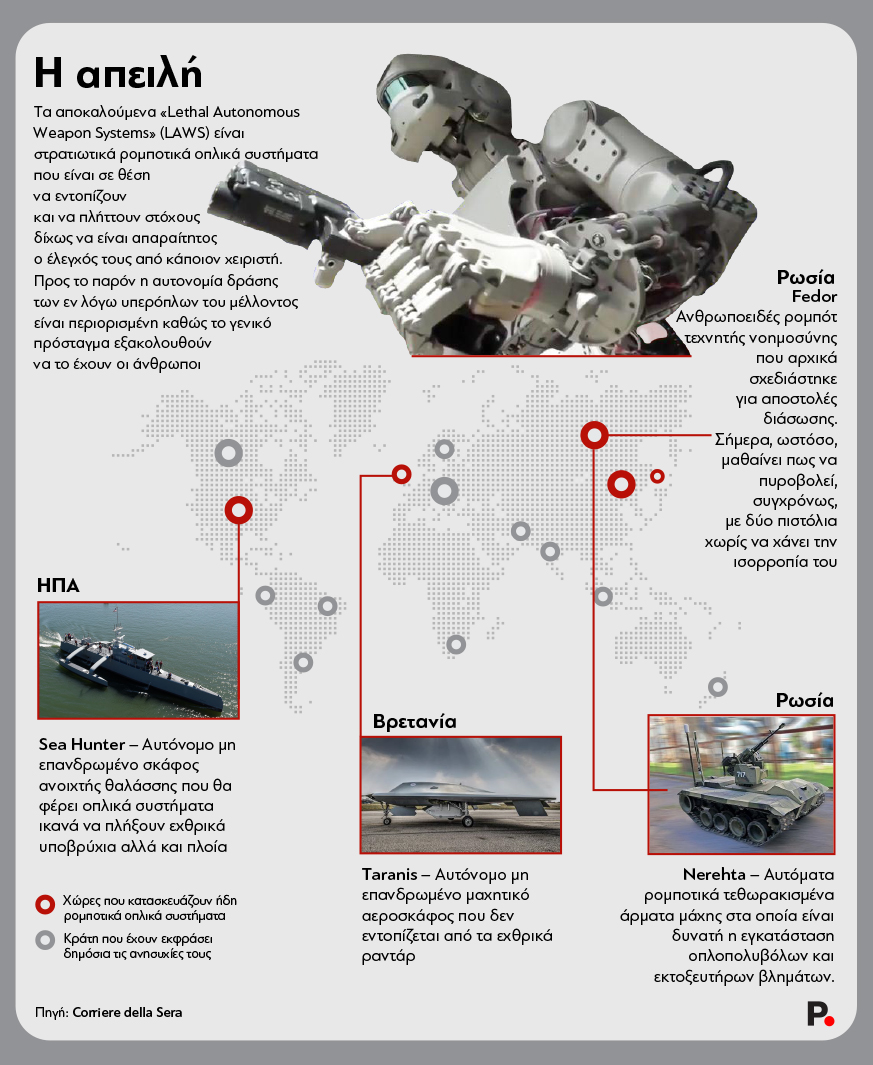

Στα οπλοστάσια του απώτερου μέλλοντος δεν θα συμπεριλαμβάνονται μόνον πύραυλοι και ιπτάμενα drones. Γιατί στα ερευνητικά κέντρα των πιο προηγμένων τεχνολογικά και στρατιωτικά χωρών του κόσμου, οι ειδικοί επιστήμονες δημιουργούν διαρκώς πρωτότυπα μοντέλα μη επανδρωμένων υποβρυχίων, καταδρομικών πλοίων που επιχειρούν δίχως πλήρωμα, αυτόματων τεθωρακισμένων αρμάτων μάχης και, κυρίως, ρομπότ-δολοφόνων, δηλαδή killer robots, όπως αποκαλούνται στη διεθνή κοινότητα. Και το σενάριο ενός πολέμου μεταξύ αυτόματων «εξολοθρευτών» που θα παρατάσσονται στη μάχη όντας κατά πολύ ισχυρότεροι από τις ανθρώπινες χερσαίες δυνάμεις, φαντάζει τουλάχιστον ανησυχητικό. Αν όχι εφιαλτικό. Γιατί τα ρομπότ-πολεμιστές του μέλλοντος προβλέπεται πως θα είναι φορείς μιας ολοένα και πιο εξελιγμένης μορφής τεχνητής νοημοσύνης που θα επιτρέπει τη λήψη αποφάσεων πάνω σε ζητήματα ζωής ή θανάτου με τρόπο αυτόνομο, δίχως την εμπλοκή του ανθρώπου.

Μετά την ανακάλυψη της πυρίτιδας και των πυρηνικών όπλων στη συνέχεια, επανάσταση στον τρόπο διεξαγωγής των πολέμων είναι σχεδόν σίγουρο πως θα φέρουν τα ρομπότ στο πλαίσιο της αποκαλούμενης -αναφέρει σε εκτενές άρθρο του το vice– «στρατιωτικοποίησης της τεχνητής νοημοσύνης». Αλλά στη χρήση των υπερσύγχρονων «LAWS» (Lethal Autonomous Weapons Systems), ελλοχεύει ο κίνδυνος ενός «θερμού επεισοδίου» ανάμεσα στις ρομποτικές δυνάμεις όχι απαραίτητα εχθρικών χωρών, είτε στα σύνορα είτε σε διεθνή ύδατα, που θα μπορούσε να εξελιχτεί ακόμα και σε έναν γενικευμένο πόλεμο με τη συμμετοχή, φυσικά, όχι μόνον ρομπότ αλλά και ανθρώπων.

Πρόκειται για νέα σενάρια πολέμου, επισημαίνει η Corriere della Sera, που θέτουν καίρια ζητήματα, κυρίως αναφορικά με το ενδεχόμενο της απώλειας ελέγχου των αυτόνομων μηχανών από την πλευρά των ανθρώπων αλλά και την απόδοση ευθυνών, τόσο σε πολιτικό όσο και νομικό επίπεδο, σε περίπτωση μιας στρατιωτικής αντιπαράθεσης. Ποια θα πρέπει να είναι η αντίδραση μιας χώρας εάν πληγεί όχι έπειτα από σχετική εντολή της ηγεσίας ενός άλλου κράτους, αλλά από ένα drone που θα ενεργοποιηθεί αυτόματα από ένα «έξυπνο» σύστημα επιτήρησης και άμυνας; Αρκετοί υποστηρίζουν επίσης πως ο περιορισμός των ανθρώπινων απωλειών, τουλάχιστον στα πεδία των μαχών, θα μείωνε σημαντικά τους όποιους ενδοιασμούς των κρατών σχετικά με τη χρήση στρατιωτικής βίας.

Ενδεικτικό των κινδύνων όσον αφορά τη «στρατιωτικοποίηση» της τεχνητής νοημοσύνης είναι το γεγονός ότι, παρότι ένας ρομποτικός πόλεμος μεγάλης κλίμακας ανήκει ακόμα στη σφαίρα της φαντασίας, ήδη από 2013 είναι ενεργό ένα παγκόσμιο κίνημα που ζητεί την απαγόρευση των LAWS. Αλλά οι πιθανότητες επιτυχίας της διεθνούς εκστρατείας Stop Killer Robots που ξεκίνησε πριν από μια πενταετία με τη στήριξη, μάλιστα, διακεκριμένων επιστημόνων, όπως ο αείμνηστος Στίβεν Χόκινγκ, και πρωτοπόρων της ψηφιακής εποχής όπως ο επίδοξος αποικιστής του πλανήτη Αρη Ελον Μασκ, ο συνιδρυτής της Apple Στιβ Βόζνιακ και ο Μουσταφά Σουλεϊμάν της Alphabet–Google, είναι λίγες. Γιατί οι πέντε διασκέψεις που έχουν ήδη πραγματοποιηθεί (η τελευταία ολοκληρώθηκε πριν από λίγες ημέρες στη Γενεύη) υπό την αιγίδα του ΟΗΕ για τη λήψη μέτρων κατά της «αυτοματοποίησης» του πολέμου και της δημιουργίας ρομποτικών στρατών δεν απέφεραν κανένα ουσιαστικό αποτέλεσμα, αν και, τουλάχιστον, 22 κράτη-μέλη του Οργανισμού εξέφρασαν επίσημα την αντίθεσή τους στην εξάπλωση της χρήσης των LAWS.

Ακολουθήστε το Protagon στο Google News